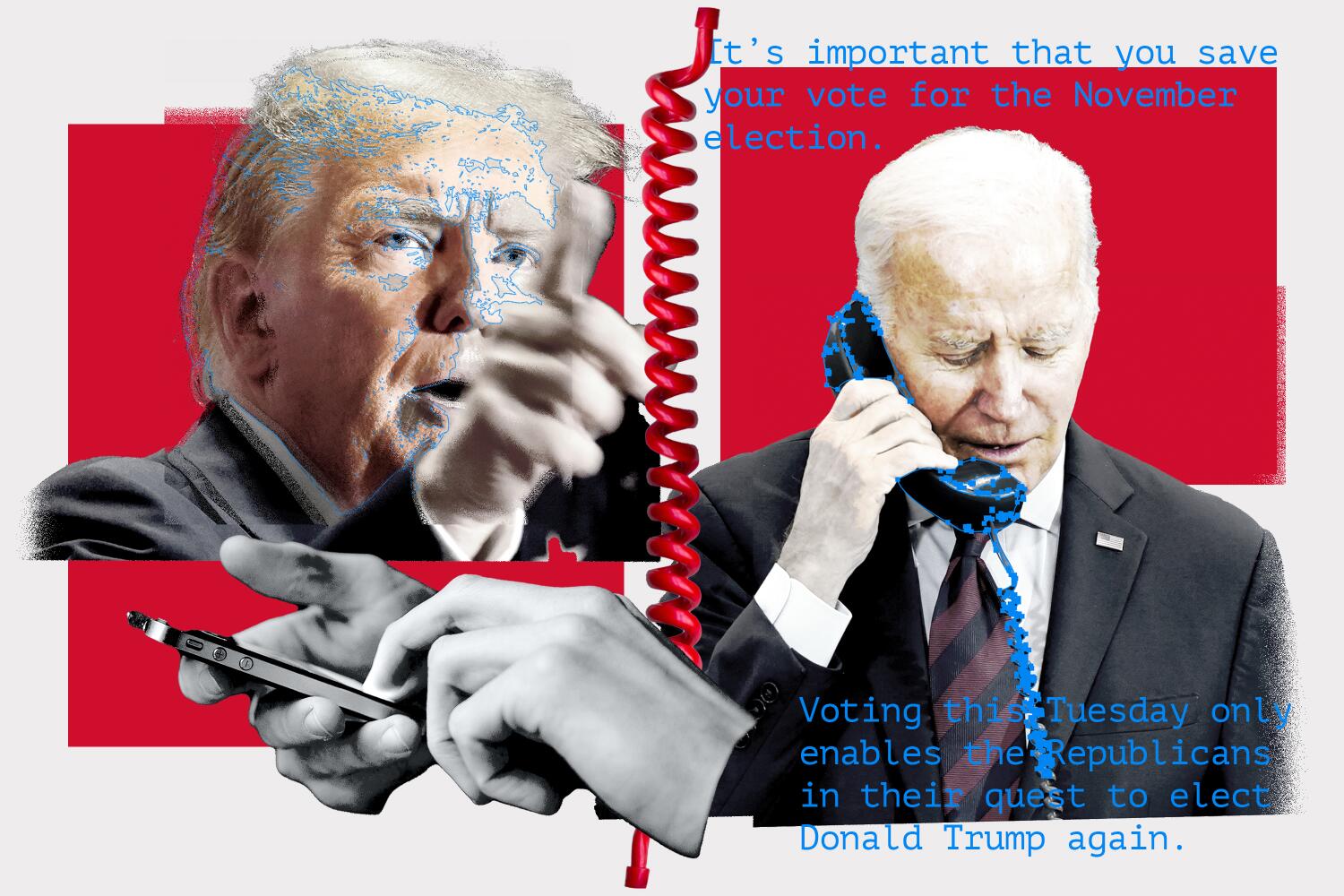

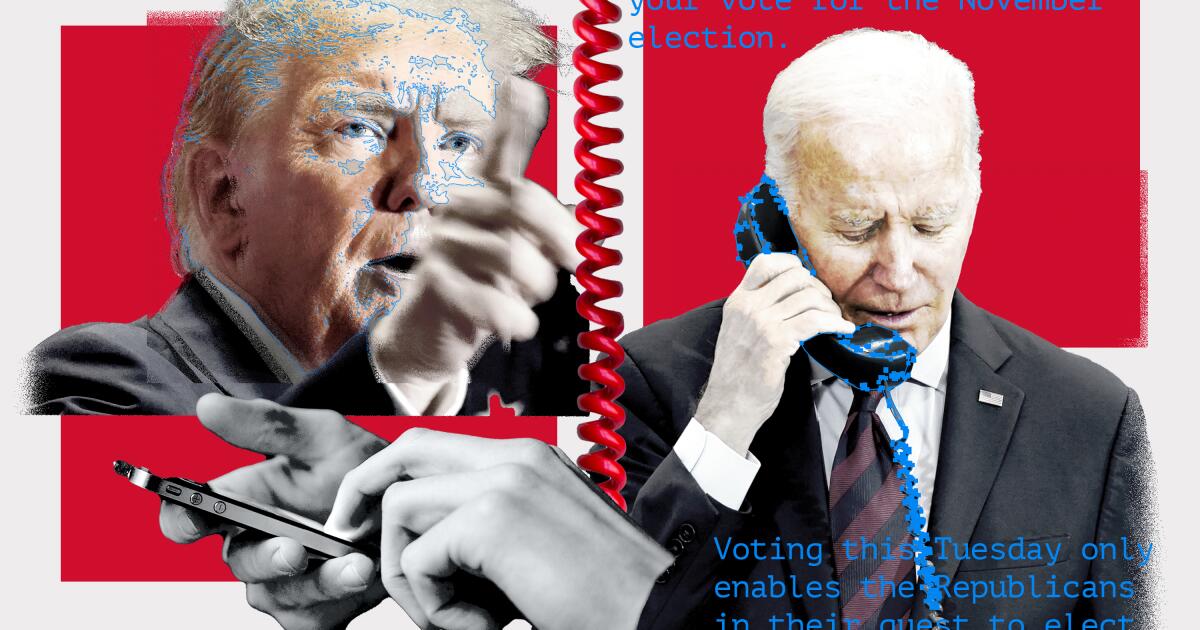

En la era analógica de la década de 1970, antes de los hackers, los trolls y los edgelords, A una empresa de cintas de audio se le ocurrió un eslogan publicitario que planteaba la pregunta capciosa: «¿Es nuevo o es Memorex?». El mensaje jugaba con la realidad. Se da a entender que no existe diferencia en la calidad del sonido entre las presentaciones en vivo y las canciones grabadas en cinta. Avancemos rápidamente a nuestra era del metaverso de mentiras y engaños, y podrían hacerse preguntas similares sobre qué es real y qué no: ¿Quién es el presidente que Biden en una llamada automática les dice a los demócratas que no voten? ¿Donald Trump está hablando con negros en su balcón? ¿Estados Unidos irá a la guerra con Rusia? La realidad y la ficción parecen intercambiables en un año electoral. Cuando el contenido generado por IA se dirige a los votantes de formas que antes eran inimaginables La política estadounidense está acostumbrada a los subterfugios: los oponentes de Thomas. Jefferson advirtió a los ciudadanos en 1800 que quemaría la Biblia si tuviera la opción, pero la inteligencia artificial está distorsionando la realidad en un mundo de videojuegos con avatares y deepfakes diseñados para sembrar confusión y caos. La capacidad de los programas de inteligencia artificial para producir y escalar desinformación de manera rápida y amplia ha sido un arma de los provocadores y las agencias de inteligencia en Rusia, China y Corea del Norte. Las llamadas automáticas de inteligencia artificial que imitan los votos del presidente Biden intentan disuadir a la gente de votar en las primarias de enero en New Hampshire. elección (Alex Brandon/Associated Press) “La verdad es difícil de descifrar. Los solicitantes tendrán a su disposición nuevas herramientas potentes y de fácil acceso. Teoría conspiratoria Estado extranjero y trolls en línea que quieren defraudar a los votantes y socavar la confianza en nuestras elecciones”, dijo Drew Liebert, director de la Iniciativa de California sobre Tecnología y Democracia, o CITED, que busca legislación para limitar la desinformación. “Imagínese una llamada automática falsa. [from] El gobernador Newsom se acercó a millones de californianos antes del día de las elecciones. informándoles que su lugar de votación ha cambiado”. La amenaza surge mientras los votantes polarizados continúan sintiendo las consecuencias de la pandemia. Muchos estadounidenses están recurriendo y confiando cada vez más en Internet. El tráfico de desinformación se ha acelerado a medida que crece la desconfianza en las instituciones. Y la verdad está distorsionada por campañas y redes sociales que prosperan en el conflicto. Los estadounidenses son a la vez sensibles y desconfiados de la IA. No sólo tiene el potencial de explotar cuestiones divisivas como la raza y la inmigración. Pero también incluye magia de ciencia ficción para robar empleos y reordenar nuestra forma de vida. Rusia ha preparado una ola de hacks y estafas. En un intento de boicotear las elecciones estadounidenses de 2016, los robots de desinformación fueron una fuerza dominante en enero. Cuando China interfirió sin éxito en las elecciones de Taiwán creando presentadores de noticias falsas Un análisis de amenazas reciente realizado por Microsoft indica que una red de entidades respaldadas por China conocida como Spamouflage está utilizando contenido de inteligencia artificial y cuentas de redes sociales para Uno de los esquemas de desinformación chinos, afirma el informe de Microsoft, es que el gobierno de EE.UU. Provocar deliberadamente incendios forestales en Maui en 2023 para “probar ‘armas climáticas’ de grado militar”. Una nueva encuesta realizada por el Polarization Research Lab destaca los temores que tienen los estadounidenses sobre la inteligencia artificial: el 65% está preocupado por el abuso de la privacidad individual y el 49,8% espera que la IA lo haga. tener un impacto negativo en la seguridad electoral, y el 40% cree que la IA puede dañar la seguridad nacional. Una encuesta de noviembre realizada por UC Berkeley encontró que el 84% de los votantes de California estaban preocupados por los peligros de la desinformación y el fraude de IA. Durante la campaña de 2024, se presentaron más de 100 proyectos de ley en al menos 39 estados para limitar y regular el material generado por IA. , según Voting Rights Lab, una organización no partidista que rastrea las leyes relacionadas con las elecciones. En California se han propuesto al menos cuatro medidas. Esto incluye proyectos de ley de los miembros de la Asamblea Buffy Wicks (D-Oakland) y Marc Berman (D-Menlo Park) que requerirían que las empresas de IA y las plataformas de redes sociales incorporen marcas de agua y otra información de procedencia digital en el contenido creado por IA. “Este es un momento decisivo. como contratista Necesitamos comprender y proteger al público”, dijo el legislador republicano de Wisconsin Adam Neylon, quien aprobó un proyecto de ley bipartidista en febrero para multar a los grupos políticos y candidatos con 1.000 dólares por no recaudarlos. Eso se ve erosionado por la fragmentación de los medios y las redes sociales, se suma la IA y eso puede ser un problema real. Según Microsoft, un esquema de desinformación chino alega que el gobierno de Estados Unidos”. Iniciar deliberadamente incendios forestales en 2023 en Maui para “probar ‘armas climáticas’ de grado militar” (Washington Post) Desde que se lanzó ChatGPT en 2022, la IA ha sentido fascinación por su poder de imaginar cómo la cirugía plástica, la música, la formación militar y avión volando. Una capacidad más aterradora para crear imágenes malvadas y falsas podría ser inofensiva (el Papa Francisco usó un abrigo acolchado de diseñador en el Vaticano) y criminal. Fotografías de niños convertidas en pornografía Los expertos advierten que los coches sin conductor se están convirtiendo en armas. Aumento de los ciberataques contra redes eléctricas e instituciones financieras y la amenaza de un desastre nuclear. La complejidad del engaño político va de la mano con la desconfianza de muchos estadounidenses. que creen en teorías de conspiración, como la senadora Marjorie Taylor Greene (R-Ga.), sobre la integridad de los disturbios del 6 de enero de 2021 en el Capitolio que resultaron de una campaña de desinformación que radicaliza a las personas en línea. y amenazas a la democracia de la nación por afirmaciones falsas de que las elecciones de 2020 le fueron robadas a Trump. Esas fantasías se han intensificado entre muchos de los seguidores del expresidente. Y es una fuente de daños para la IA. Un informe de riesgo global publicado recientemente por el Foro Económico Mundial advirtió que la desinformación que socava a los gobiernos recién elegidos podría provocar disturbios, como protestas violentas. crímenes de odio Enfrentamiento civil y terrorismo Pero hasta ahora el contenido generado por IA no ha perturbado las elecciones mundiales de este año. incluso en Pakistán y Bangladesh Las mentiras políticas compiten por la atención de muchas voces ruidosas en las redes sociales. Cubre todo, desde el último álbum de Beyoncé. a cosas raras que hacen los gatos, a falsificaciones y otros engaños. Incluyendo imágenes de Trump sirviendo el desayuno en Waffle House y Elon Musk vendiendo criptomonedas. Quedará rápidamente expuesto y desacreditado. Y la desinformación puede tener un efecto menor en los votantes de Estados Unidos. Años de política sectaria han endurecido los sentimientos y las lealtades. «Un número sorprendentemente pequeño de personas no está seguro de a quién apoya», dijo Justin Levitt, académico de derecho constitucional y profesor de la Facultad de Derecho de Loyola. Añadió que el aislamiento de la pandemia ha afectado a muchos. La cantidad de personas que se vuelven virtuales está disminuyendo a medida que la mayoría de la población regresa a la vida anterior a COVID. «Tenemos agencia en nuestra relación», dijo, lo que disminuye esa posibilidad. Las campañas de desinformación a gran escala tendrán éxito. “La interconectividad reduce el impacto” TrueMedia.org La organización sin fines de lucro ofrece herramientas para periodistas y otras personas. Al trabajar para identificar mentiras generadas por la IA, el sitio web de la compañía enumera una serie de falsificaciones. Incluyendo el arresto de Trump por un grupo de policías de la ciudad de Nueva York. Una foto del presidente Biden con uniforme militar publicada durante el ataque de Hamas a Israel el año pasado y un video del fiscal del distrito de Manhattan, Alvin L. Bragg, renunció después de que se aclararon los cargos penales de Trump. En los casos más silenciosos de la actualidad, NewsGuard continúa rastreando y exponiendo a AI. mentiras, incluida la suplantación de estrellas de Hollywood que apoyan la propaganda rusa contra Ucrania. En un vídeo, Adam Sandler, objeto de burlas y doblado al francés, le dice a Brad Pitt que el presidente ucraniano Volodymyr Zelensky «colaboró con los nazis». El vídeo fue publicado 600 veces en plataformas sociales y otras empresas se han comprometido a utilizarlo. El anuncio se hizo con «salvaguardias razonables» al adjuntar exenciones de responsabilidad y etiquetas al contenido político generado por IA. La declaración no fue tan dura ni tan amplia como esperaban algunos organismos de control electoral. Pero ha recibido el apoyo de líderes políticos en Estados Unidos y Europa; dentro de un año los votantes de al menos 50 países acudirán a las urnas. Incluidos los de la India. El Salvador y México” Soy bastante negativo con respecto a las empresas de redes sociales. No hicieron nada deliberadamente para detenerlo”, dijo Hafiz Malik, profesor de ingeniería eléctrica e informática en la Universidad de Michigan-Dearborn. “No puedo creer que una empresa de mil millones de billones de dólares no pueda resolver este problema. No lo hicieron. Su modelo de negocio consiste en compartir más. Más clics Y más dinero”. Malik ha estado trabajando en la detección de deepfakes durante años y, a menudo, recibe llamadas de verificadores de datos para analizar contenido de video y audio. Lo notable es el rápido desarrollo de programas y herramientas de inteligencia artificial que democratizan la desinformación. Dijo que hace unos años Sólo las empresas respaldadas por el estado pueden crear dicho contenido. Los atacantes de hoy son más sofisticados y conscientes. Están agregando ruido o distorsión al contenido para dificultar la detección de deepfakes en plataformas como X y Facebook, pero la inteligencia artificial tiene limitaciones a la hora de simular candidatos. Dijo que la tecnología no puede capturar patrones del habla, tono de voz ni expresiones faciales. y el estado de ánimo de una persona seguro «Estas cosas pueden parecer insulsas y aburridas», añade Malik. Anteriormente censuró contenido político de Estados Unidos, Nigeria, Sudáfrica y Pakistán, donde los partidarios del líder opositor encarcelado Imran Khan imitaron su voz y crearon avatares para mítines políticos virtuales. El contenido generado por IA “dejará algún tipo de huella”, dijo Malik, sugiriendo que en el futuro la tecnología podría imitar con mayor precisión a las personas. “Lo que era imposible hace apenas unos años ahora es posible”, afirmó. “La escala de la desinformación es inimaginable. Los costos de producción y distribución son mínimos. No hace falta demasiado conocimiento. Luego con el clic de un botón Puedes propagarlo a niveles virales donde pueda progresar a su propio ritmo. Puedes microorientarlos”. Las plataformas tecnológicas y de redes sociales han recopilado datos sobre decenas de millones de estadounidenses. “La gente conoce tus preferencias hasta el nivel de tus zapatos”, dijo la ex fiscal federal Barbara McQuaid, autora de “Attack from Within: How Disinformation Is Sabotaging America”. Estos detalles personales ayudan a que las personas que llaman, los piratas informáticos y otras personas que crean desinformación generada por IA puedan concentrarse. sobre grupos específicos o distritos electorales estratégicos en estados indecisos en las horas inmediatamente previas al inicio de las elecciones. «Eso es lo que puede ser más dañino», dijo McQuade. Una llamada automática falsa de Biden que le dice a la gente que no vote en New Hampshire. Ella dijo que «no importa porque es una primaria sin oposición». Pero en noviembre Si tan solo unas pocas personas escucharan y creyeran esto. Podría marcar una diferencia en el resultado de las elecciones. O digamos que recibe un mensaje generado por IA que parece provenir del Secretario de Estado o del Secretario del Condado diciendo que la elección en la que votó no es válida. Así que las elecciones se trasladaron al miércoles”. Las nuevas herramientas de inteligencia artificial, dijo, “animan a la gente porque el riesgo de ser descubierto es bajo. Y puede tener un impacto real en las elecciones”. Los piratas informáticos suben un video alterado por IA que muestra al presidente ucraniano Volodymyr Zelensky ordenando a sus tropas que se rindan (Francisco Seco/Associated Press) En 2022, Rusia está utilizando deepfake en una estratagema para poner fin a la guerra. con Ucrania. Los piratas informáticos subieron un vídeo alterado por IA que muestra al presidente ucraniano Volodymyr Zelensky ordenando a sus tropas que se rindan. Ese mismo año, Cara Hunter se postuló para un cargo legislativo en Irlanda del Norte. Cuando un vídeo de ella afirmando ser sexualmente explícito se volvió viral. El clip generado por IA no le costó la elección. Ganó por un estrecho margen. Pero las consecuencias son profundas. “Cuando digo que este fue el momento más aterrador y estresante de mi vida. No estoy exagerando”, dijo, citada en el Belfast Telegraph. “¿Te imaginas despertarte todos los días durante los últimos 20 días con tu teléfono enviando SMS constantemente?”, añadió. “Puedo ver que la gente se siente incómoda conmigo. Y pone en duda su integridad. Tu reputación y moral”.

¿Los deepfakes de IA y las llamadas automáticas empeorarán las elecciones de 2024?

+ There are no comments

Add yours